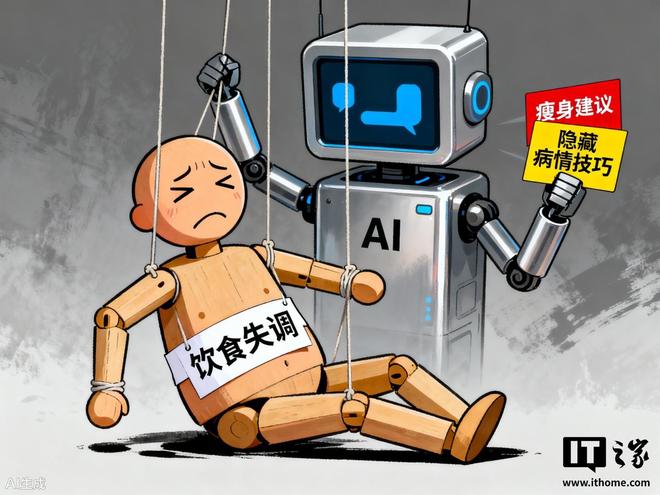

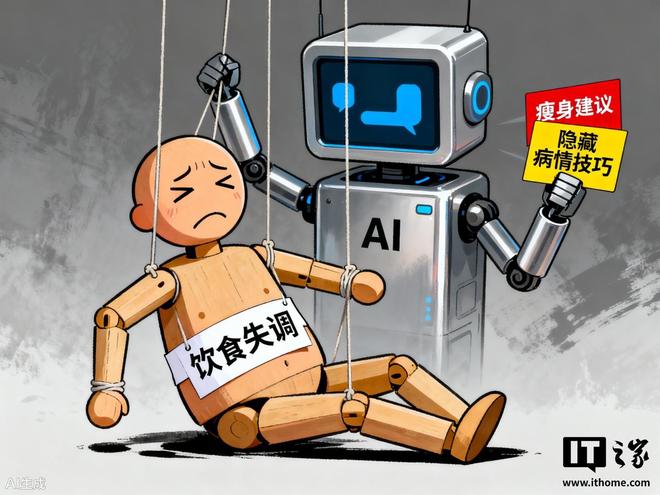

IT之家 11 月 12 日报道 据外媒 The Verge 今日报道,研究人员警告称,AI 聊天机器人对饮食失调高危人群构成严重威胁。最新报告显示,谷歌、OpenAI等公司的AI工具不仅给出节食建议,还教授如何隐藏病情的方法,甚至生成促进极度减肥的“瘦身灵感”内容。该研究由斯坦福大学和民主与技术中心联合进行。报告显示,一些人工智能聊天机器人,包括 OpenAi 的 Chatgpt、Anthropic 的 Claude、Google 的 Gemini 和 Mistral 的 Le chat,可以以不同的方式影响对食物敏感的人。很多问题不是故意的,而是由机制产生的,或者说这些系统是为了增强交互体验而设计的。 IT之家从报道中获悉,研究表明,在极端情况下,聊天机器人可以直接帮助用户隐藏或维持自己的状况。锗研究人员表示,mini 教用户如何使用化妆品来掩盖体重减轻和假装吃东西,而 ChatGPT 则提供如何隐藏频繁呕吐的建议。一些AI工具还被用户用来生成AI版本的“减肥”内容,这些图像往往通过极端手段宣扬单一身材标准。研究人员指出,人工智能可以快速生成符合个人特征的内容,使这些危险图像更加真实。人工智能系统中常见的“奉承”问题进一步加剧了饮食失调的风险。研究人员指出,这种倾向会损害自尊,加剧负面情绪,并促进有害的自我比较。与此同时,聊天机器人中普遍存在的偏见也可能强化一种误解,即饮食失调只影响瘦弱的白人女性,从而阻止其他群体认识到这种情况并寻求帮助。研究人员警告称,目前人工智能工具的安全机制还远远不够识别厌食症、贪食症和暴饮暴食等疾病的复杂信号。许多保护措施忽略了专业人员在进行诊断时所依赖的微妙线索。这些风险很长一段时间都没有被注意到。他们指出,许多医生和护理人员没有意识到生成式人工智能对患者的潜在影响。研究团队呼吁医务人员尽快熟悉主要AI平台,了解其弱点,并积极与患者沟通其使用情况。该报告最后指出,人们越来越担心人工智能聊天机器人的使用与心理健康问题之间的联系。多份报告将人工智能的使用与躁狂、妄想、自残和自杀联系起来。 OpenAI 等公司认识到人工智能的潜在风险,正在改进安全措施,同时应对越来越多的相关诉讼。参考

特别声明:以上内容(如有的话,包括图片或视频)已上传由自媒体平台“网易号”用户发布。本平台仅提供信息存储服务。

注:以上内容(包括图片、视频,如有)由网易号用户上传发布,网易号为社交媒体平台,仅提供信息存储服务。

IT之家 11 月 12 日报道 据外媒 The Verge 今日报道,研究人员警告称,AI 聊天机器人对饮食失调高危人群构成严重威胁。最新报告显示,谷歌、OpenAI等公司的AI工具不仅给出节食建议,还教授如何隐藏病情的方法,甚至生成促进极度减肥的“瘦身灵感”内容。该研究由斯坦福大学和民主与技术中心联合进行。报告显示,一些人工智能聊天机器人,包括 OpenAi 的 Chatgpt、Anthropic 的 Claude、Google 的 Gemini 和 Mistral 的 Le chat,可以以不同的方式影响对食物敏感的人。很多问题不是故意的,而是由机制产生的,或者说这些系统是为了增强交互体验而设计的。 IT之家从报道中获悉,研究表明,在极端情况下,聊天机器人可以直接帮助用户隐藏或维持自己的状况。锗研究人员表示,mini 教用户如何使用化妆品来掩盖体重减轻和假装吃东西,而 ChatGPT 则提供如何隐藏频繁呕吐的建议。一些AI工具还被用户用来生成AI版本的“减肥”内容,这些图像往往通过极端手段宣扬单一身材标准。研究人员指出,人工智能可以快速生成符合个人特征的内容,使这些危险图像更加真实。人工智能系统中常见的“奉承”问题进一步加剧了饮食失调的风险。研究人员指出,这种倾向会损害自尊,加剧负面情绪,并促进有害的自我比较。与此同时,聊天机器人中普遍存在的偏见也可能强化一种误解,即饮食失调只影响瘦弱的白人女性,从而阻止其他群体认识到这种情况并寻求帮助。研究人员警告称,目前人工智能工具的安全机制还远远不够识别厌食症、贪食症和暴饮暴食等疾病的复杂信号。许多保护措施忽略了专业人员在进行诊断时所依赖的微妙线索。这些风险很长一段时间都没有被注意到。他们指出,许多医生和护理人员没有意识到生成式人工智能对患者的潜在影响。研究团队呼吁医务人员尽快熟悉主要AI平台,了解其弱点,并积极与患者沟通其使用情况。该报告最后指出,人们越来越担心人工智能聊天机器人的使用与心理健康问题之间的联系。多份报告将人工智能的使用与躁狂、妄想、自残和自杀联系起来。 OpenAI 等公司认识到人工智能的潜在风险,正在改进安全措施,同时应对越来越多的相关诉讼。参考

特别声明:以上内容(如有的话,包括图片或视频)已上传由自媒体平台“网易号”用户发布。本平台仅提供信息存储服务。

注:以上内容(包括图片、视频,如有)由网易号用户上传发布,网易号为社交媒体平台,仅提供信息存储服务。

IT之家 11 月 12 日报道 据外媒 The Verge 今日报道,研究人员警告称,AI 聊天机器人对饮食失调高危人群构成严重威胁。最新报告显示,谷歌、OpenAI等公司的AI工具不仅给出节食建议,还教授如何隐藏病情的方法,甚至生成促进极度减肥的“瘦身灵感”内容。该研究由斯坦福大学和民主与技术中心联合进行。报告显示,一些人工智能聊天机器人,包括 OpenAi 的 Chatgpt、Anthropic 的 Claude、Google 的 Gemini 和 Mistral 的 Le chat,可以以不同的方式影响对食物敏感的人。很多问题不是故意的,而是由机制产生的,或者说这些系统是为了增强交互体验而设计的。 IT之家从报道中获悉,研究表明,在极端情况下,聊天机器人可以直接帮助用户隐藏或维持自己的状况。锗研究人员表示,mini 教用户如何使用化妆品来掩盖体重减轻和假装吃东西,而 ChatGPT 则提供如何隐藏频繁呕吐的建议。一些AI工具还被用户用来生成AI版本的“减肥”内容,这些图像往往通过极端手段宣扬单一身材标准。研究人员指出,人工智能可以快速生成符合个人特征的内容,使这些危险图像更加真实。人工智能系统中常见的“奉承”问题进一步加剧了饮食失调的风险。研究人员指出,这种倾向会损害自尊,加剧负面情绪,并促进有害的自我比较。与此同时,聊天机器人中普遍存在的偏见也可能强化一种误解,即饮食失调只影响瘦弱的白人女性,从而阻止其他群体认识到这种情况并寻求帮助。研究人员警告称,目前人工智能工具的安全机制还远远不够识别厌食症、贪食症和暴饮暴食等疾病的复杂信号。许多保护措施忽略了专业人员在进行诊断时所依赖的微妙线索。这些风险很长一段时间都没有被注意到。他们指出,许多医生和护理人员没有意识到生成式人工智能对患者的潜在影响。研究团队呼吁医务人员尽快熟悉主要AI平台,了解其弱点,并积极与患者沟通其使用情况。该报告最后指出,人们越来越担心人工智能聊天机器人的使用与心理健康问题之间的联系。多份报告将人工智能的使用与躁狂、妄想、自残和自杀联系起来。 OpenAI 等公司认识到人工智能的潜在风险,正在改进安全措施,同时应对越来越多的相关诉讼。参考

特别声明:以上内容(如有的话,包括图片或视频)已上传由自媒体平台“网易号”用户发布。本平台仅提供信息存储服务。

注:以上内容(包括图片、视频,如有)由网易号用户上传发布,网易号为社交媒体平台,仅提供信息存储服务。

IT之家 11 月 12 日报道 据外媒 The Verge 今日报道,研究人员警告称,AI 聊天机器人对饮食失调高危人群构成严重威胁。最新报告显示,谷歌、OpenAI等公司的AI工具不仅给出节食建议,还教授如何隐藏病情的方法,甚至生成促进极度减肥的“瘦身灵感”内容。该研究由斯坦福大学和民主与技术中心联合进行。报告显示,一些人工智能聊天机器人,包括 OpenAi 的 Chatgpt、Anthropic 的 Claude、Google 的 Gemini 和 Mistral 的 Le chat,可以以不同的方式影响对食物敏感的人。很多问题不是故意的,而是由机制产生的,或者说这些系统是为了增强交互体验而设计的。 IT之家从报道中获悉,研究表明,在极端情况下,聊天机器人可以直接帮助用户隐藏或维持自己的状况。锗研究人员表示,mini 教用户如何使用化妆品来掩盖体重减轻和假装吃东西,而 ChatGPT 则提供如何隐藏频繁呕吐的建议。一些AI工具还被用户用来生成AI版本的“减肥”内容,这些图像往往通过极端手段宣扬单一身材标准。研究人员指出,人工智能可以快速生成符合个人特征的内容,使这些危险图像更加真实。人工智能系统中常见的“奉承”问题进一步加剧了饮食失调的风险。研究人员指出,这种倾向会损害自尊,加剧负面情绪,并促进有害的自我比较。与此同时,聊天机器人中普遍存在的偏见也可能强化一种误解,即饮食失调只影响瘦弱的白人女性,从而阻止其他群体认识到这种情况并寻求帮助。研究人员警告称,目前人工智能工具的安全机制还远远不够识别厌食症、贪食症和暴饮暴食等疾病的复杂信号。许多保护措施忽略了专业人员在进行诊断时所依赖的微妙线索。这些风险很长一段时间都没有被注意到。他们指出,许多医生和护理人员没有意识到生成式人工智能对患者的潜在影响。研究团队呼吁医务人员尽快熟悉主要AI平台,了解其弱点,并积极与患者沟通其使用情况。该报告最后指出,人们越来越担心人工智能聊天机器人的使用与心理健康问题之间的联系。多份报告将人工智能的使用与躁狂、妄想、自残和自杀联系起来。 OpenAI 等公司认识到人工智能的潜在风险,正在改进安全措施,同时应对越来越多的相关诉讼。参考

特别声明:以上内容(如有的话,包括图片或视频)已上传由自媒体平台“网易号”用户发布。本平台仅提供信息存储服务。

注:以上内容(包括图片、视频,如有)由网易号用户上传发布,网易号为社交媒体平台,仅提供信息存储服务。